扰动的意思

扰动步长翻译

在计算机科学和数学领域中,"扰动步长翻译"是一种用于数值优化和机器学习中的技术。该技术的目标是通过改变优化算法中的步长或学习率来优化模型的性能。

1. 背景

在优化问题中,步长(或学习率)是一个关键参数,它决定了在每次迭代中更新模型参数的幅度。如果步长设置得太小,优化过程会变得缓慢,可能会陷入局部最小值。而如果步长设置得太大,可能会导致优化过程不稳定甚至发散。

2. 扰动步长翻译的原理

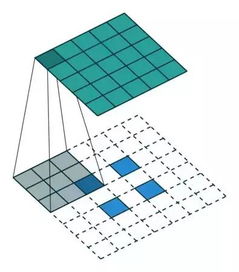

扰动步长翻译的核心思想是在每次迭代中引入一定程度的随机性,以避免陷入局部最小值并提高算法的鲁棒性。具体来说,它包括以下步骤:

初始化步长

:给定一个初始的步长或学习率,通常根据经验或预先设定的规则来确定。

计算扰动

:在每次迭代中,计算一个随机扰动量,可以是服从某种分布的随机数,比如均匀分布或高斯分布。

更新步长

:将步长与扰动相结合,得到每次迭代的实际步长。这样做可以使步长在每次迭代中有所波动,从而增加了搜索空间,提高了算法的全局搜索能力。

3. 优点与应用

避免陷入局部最小值

:通过引入随机性,扰动步长翻译可以帮助优化算法跳出局部最小值,更有可能找到全局最优解。

增加算法的鲁棒性

:由于步长在每次迭代中都会有所变化,扰动步长翻译对于处理不同类型的优化问题都具有一定的鲁棒性。

适用于各种优化算法

:扰动步长翻译并不限于特定的优化算法,它可以与梯度下降、随机梯度下降等各种优化方法结合使用。

常见于深度学习中

:在深度学习领域,扰动步长翻译常常用于调整神经网络模型的学习率,以加速训练过程并提高模型的性能。 4. 注意事项

调整扰动大小

:扰动的大小需要合理调整,过大的扰动可能会导致优化过程不稳定,而过小的扰动则可能无法有效避免局部最小值。

谨慎选择分布

:扰动量的分布应根据具体问题来选择,不同的分布可能适用于不同类型的优化问题。

需权衡计算成本

:引入扰动会增加计算成本,需要权衡随机性带来的收益和额外的计算开销。 5. 总结

扰动步长翻译是一种有效的优化技术,通过在优化算法中引入随机性,可以提高算法的全局搜索能力和鲁棒性。在实际应用中,需要根据具体问题合理调整扰动大小和分布,并权衡随机性带来的收益和计算成本。这一技术在机器学习、深度学习等领域具有广泛的应用前景。

免责声明:本网站部分内容由用户自行上传,若侵犯了您的权益,请联系我们处理,谢谢!联系QQ:2760375052